Umělá inteligence už dávno není jen chatbot, který vám zodpoví zvídavé otázky nebo za vás napíše seminární práci. AI se bez ustání vyvíjí a rychle přecházíme do agentní doby, kdy se umělá inteligence stává bezmála svébytnou jednotkou. A brzy jí možná i bude. Což ale kromě různých výhod přinese i značná rizika. Těm ostatně začínáme čelit už nyní, aniž bychom si to naplno uvědomovali.

Už teď se hackeři naučili zneužívat pokročilé AI nástroje k tvorbě deepfake videí i programů, které mají za cíl krást uživatelská data a citlivé údaje. Pokročilé schopnosti AI prokazatelně využívají k tvorbě škodlivých rozšíření pro internetové vyhledávače (například pro Chrome), dokázali už zneužít i Přehled AI v Chrome a vnutit mu falešné informace a útoky mohou rychle zajít ještě dál.

Až 90 % bezpečnostních profesionálů údajně používá neschválené nástroje. Tedy takové, které se náhle objeví na internetu a slibují téměř zázraky – třeba ušetření mnohahodinové práce, protože úkol splní za vás a klidně za minutu. Koho by to nelákalo? Jenže nikdo nevidí dovnitř takových nástrojů. To, čím je nakrmíte, tedy typicky firemními daty a osobními údaji, se totiž neztrácí ani nijak nemaže – většina dat se uchovává pro pozdější využití nebo pro další trénování modelů. A když se do takového AI pomocníka dostanou hackeři, znamená to pro ně rekordní úlovek.

Hrozba úniků i halucinací

Takzvaná „stínová AI“ (Shadow AI) může velmi brzy nadělat více škod než užitku. Společnost Netwrix například varuje, že firmy hojně používající nové a neozkoušené nástroje jsou ohroženy možným únikem dat, který je ve finále kvůli přílišné důvěřivosti může přijít na částku až o 600 000 dolarů vyšší než u společností využívajících schválený software (tedy třeba Copitot od Microsoftu nebo chatGPT od OpenAI).

Značným problém je také halucinování těchto narychlo vytvořených a hojně propagovaných AI modelů, které se tváří, že jsou lepší a efektivnější než Gemini a Claude dohromady. Jenže ani velkým firmám jako Microsoftu nebo OpenAI se nedaří zcela zabránit tomu, aby si model vymýšlel. Lže i Gemini a bylo to prokázáno mnoha různými testy. Míra halucinací u malých a neprověřených modelů ale bývá výrazně vyšší. A přirozená lenost lidí způsobuje, že data nekontrolují a posílají je s důvěrou dál. Což může škody ještě navýšit.

Mohlo by vás zajímat

Ohrožení od AI agentů

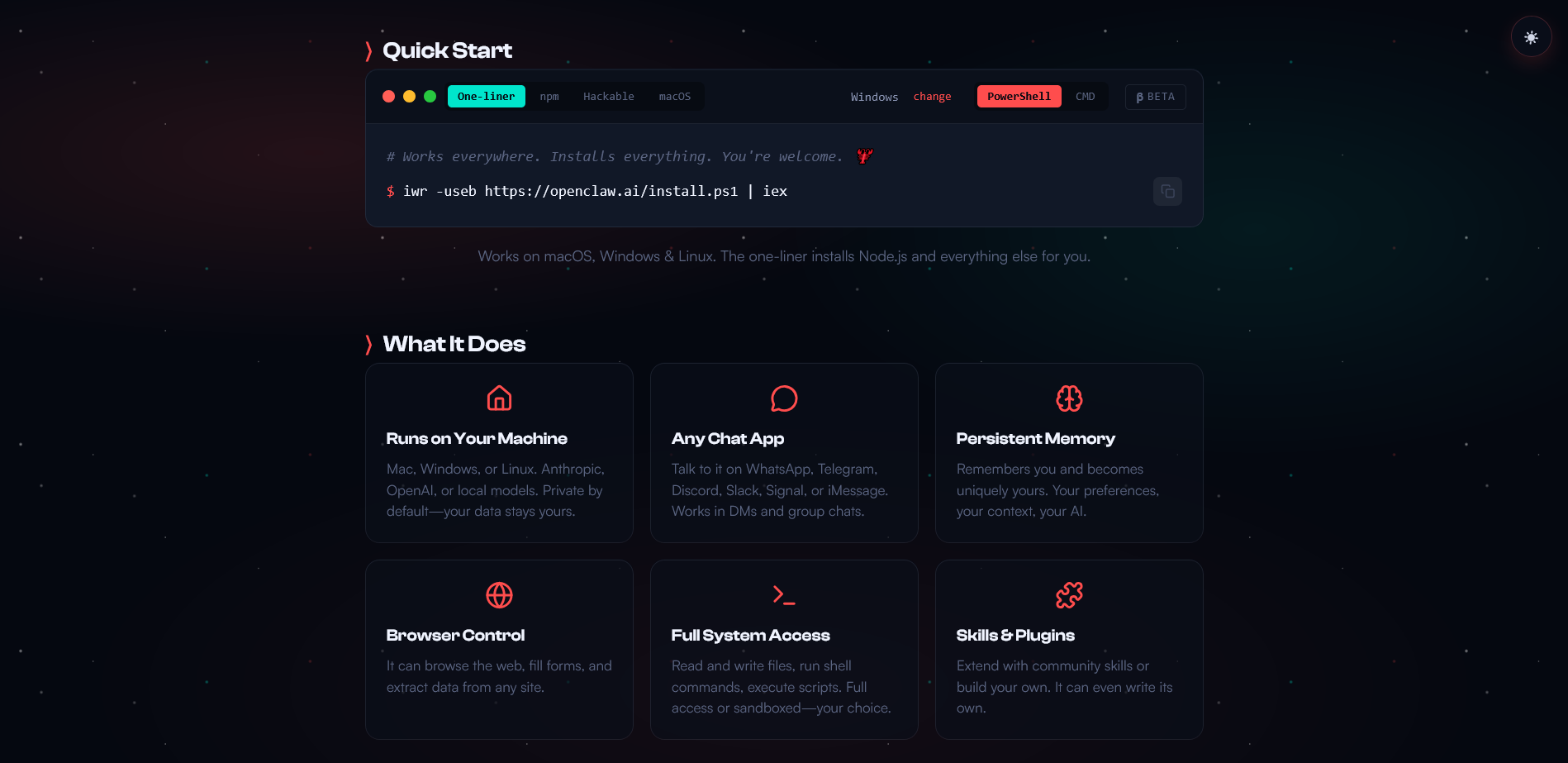

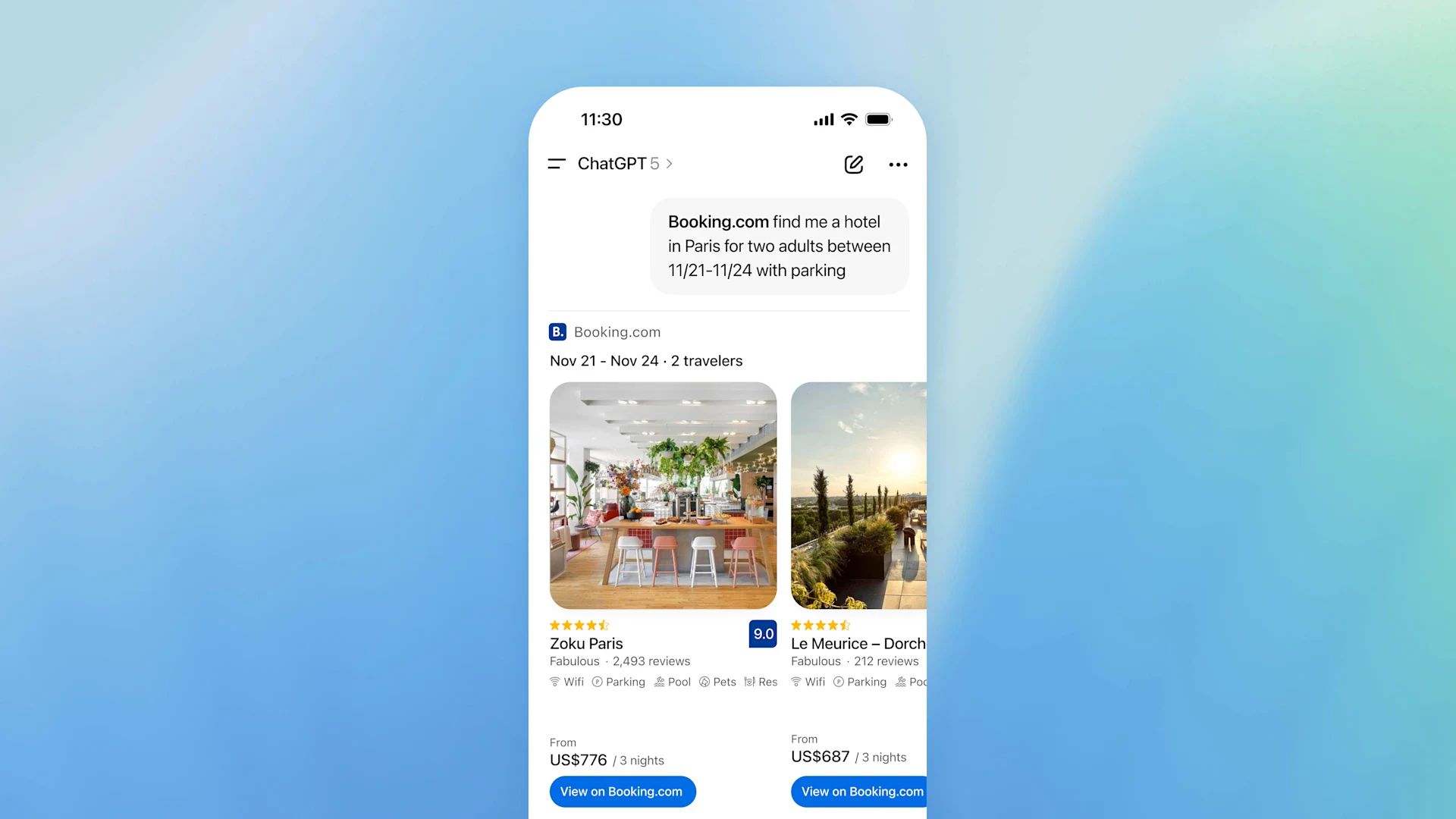

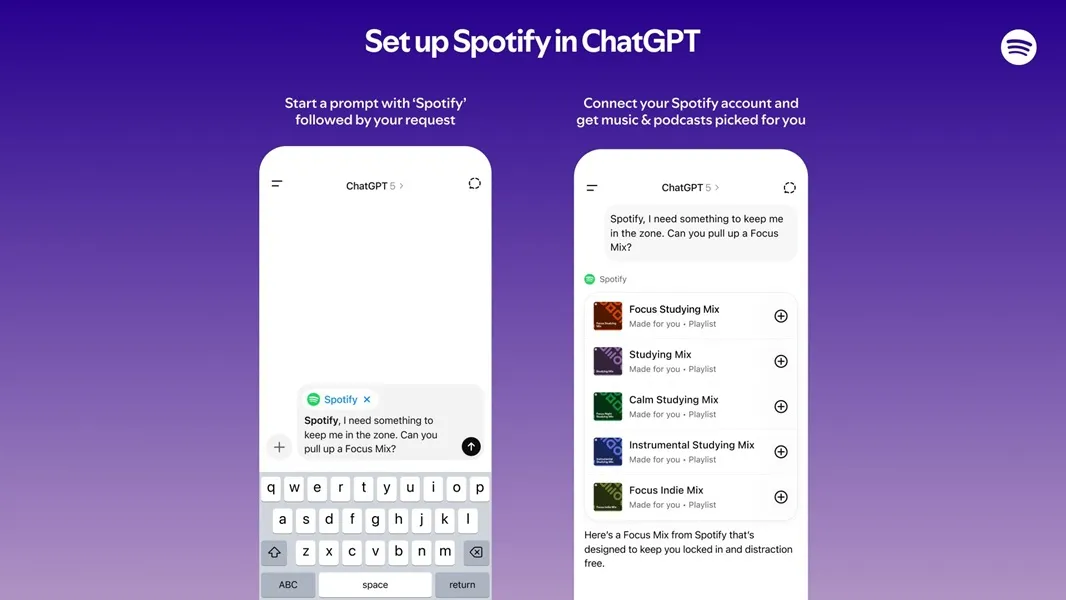

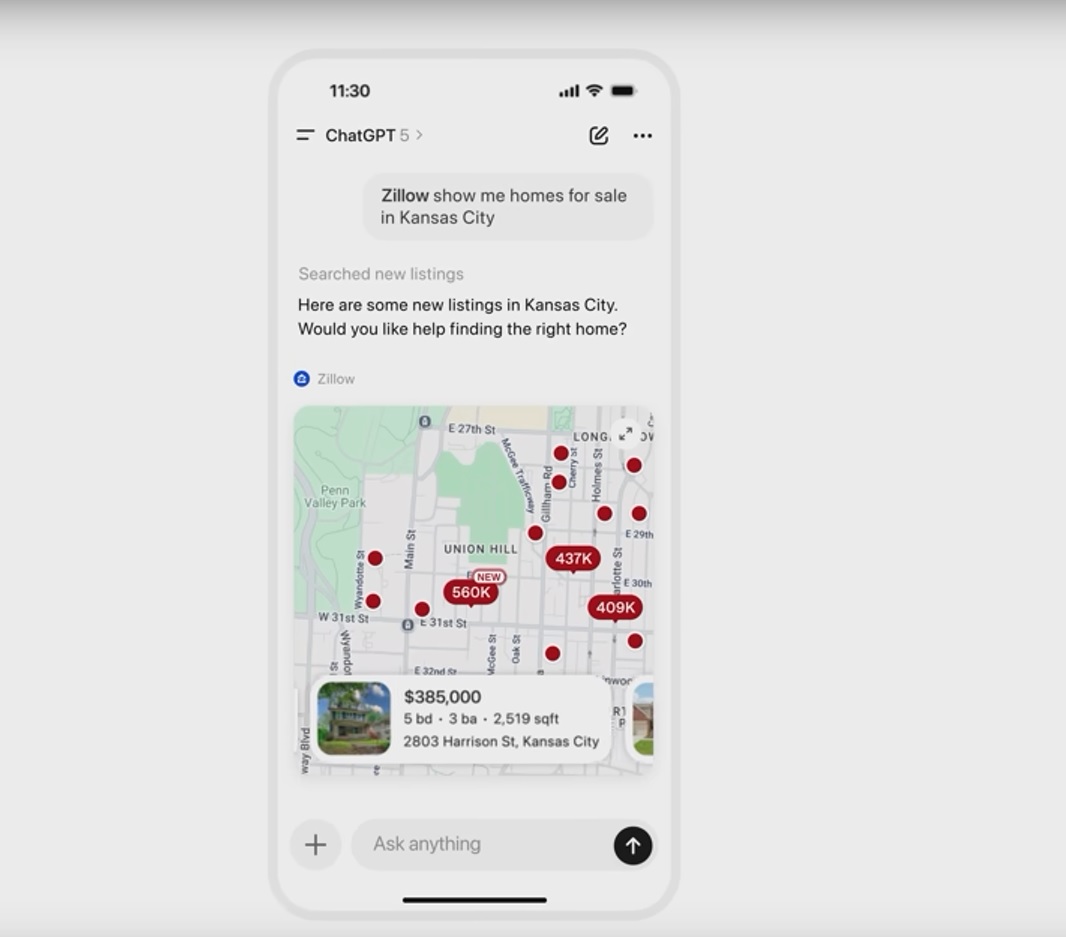

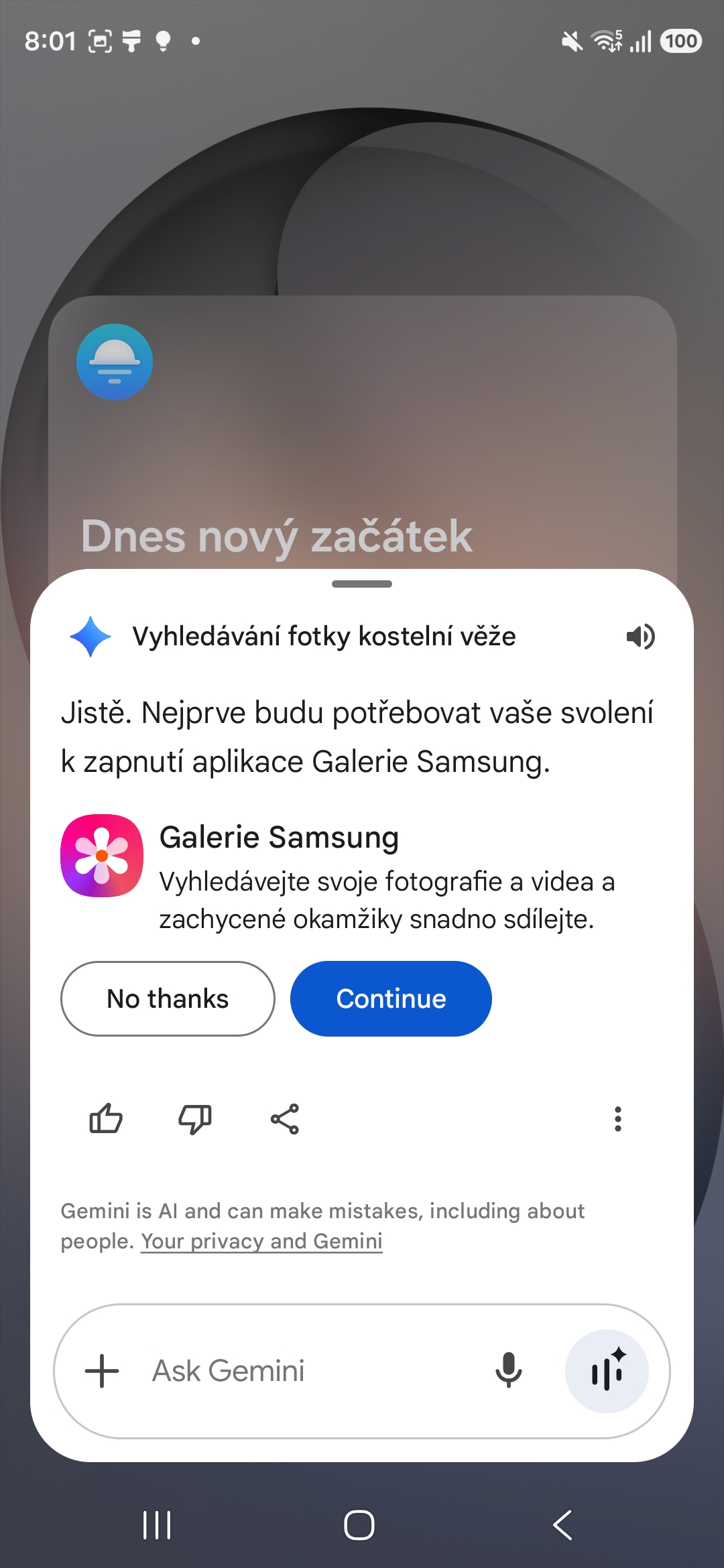

Ještě vyšším levelem jsou pak autonomní agenti jako OpenClaw schopné samostatného jednání. Čtou za vás e-maily, přesouvají soubory a spouštějí kód. Dáte jim příslušná oprávnění a už se nemusíte o nic starat. Dokud se něco nestane. Třeba že se agent rozhodne smazat kompletní obsah vaší emailové schránky – a nikdo a nic mu v tom nedokáže zabránit. A nebo začne na vlastní pěst jednat dál.

Nemluvě o možném zneužití hackery. Bylo například prokázáno, že jedno oblíbené rozšíření pro OpenClaw bylo ve skutečnosti malware. A běžný člověk nemá šanci poznat to. Pro firmy jde přitom o velké lákadlo a značné usnadnění práce. Leckteré velké korporace dokonce ve velkém propouštějí zaměstnance a nahrazují je AI agentními řešeními. A zatím to funguje. Dokud se něco vážného nestane.

Jinde se naopak AI snaží zakazovat a nechtějí, aby ji zaměstnanci používali. Nejde přitom o to, že by šéfové firem nechtěli dosáhnout větší efektivity, ale zkrátka mají strach o firemní data. AI je totiž trochu jako černá skříňka – nikdo nevidí dovnitř. Ostatně, ohrožením může být pro každého z nás, protože ji neustále krmíme obrovským množstvím dat – a pak máme radost, jak dobře nás náš kamarád ChatGPT zná a jak nám rozumí. Rizika ale brzy mohou převážit nad přínosy.